Como alguien que ha trabajado con big data durante algún tiempo, he empujado los límites donde esta idea de relevancia se transforma en espeluznante: recuerde el infame estudio de caso: ¿Cómo Target descubrió que una niña estaba embarazada antes que su padre?

Soy muy consciente de las implicaciones de la IA en el marketing digital, su atractivo para las grandes empresas y, al mismo tiempo, el miedo que crea entre los consumidores.

A medida que los datos se vuelven más abundantes y las huellas digitales de los consumidores se vuelven comunes, se analiza y contextualiza una mayor comprensión de sus vidas. El consumidor promedio está cada vez más informado sobre lo que comparte y cómo lo usan las empresas, muchas veces sin el reconocimiento o consentimiento del usuario.

La IA está acelerando su ritmo y, con ella, los conjuntos de datos masivos permiten el análisis y la contextualización de la información que tiene beneficios inherentes… pero también vulnerabilidades para las personas y la sociedad, reales y aún por revelar.

En 2012 escribí esta publicación en el blog de mi empresa Genx Think Tank: Se trata de privacidad. En ese momento, todos coincidieron en que el uso de las plataformas sociales es un intercambio justo de recopilación de datos de los usuarios. Julie Bernard, directora de marketing de Macy’s, dijo:

Hay algo gracioso con los consumidores… Están preocupados por el uso que hacemos de los datos, pero se enojan si no entrego relevancia. … ¿Cómo se supone que debo entregar relevancia y mágicamente entregar lo que quieren si no miro los datos?

Algunos usuarios más sofisticados no estaban dispuestos a proporcionar demasiada información a ninguna empresa y preferían utilizar diferentes servicios de navegación. Ghostery y otros bloqueadores de anuncios permiten a los usuarios ver quién los estaba rastreando. Esto hace que sea más difícil para las redes publicitarias monetizar de manera efectiva. Más importante aún, reduce la cantidad de información que las empresas pueden rastrear sobre sus usuarios.

Avance rápido hasta hoy…

Ahora es 2018 y la adopción de Ghostery y otros sistemas de seguimiento ha crecido significativamente. Business Insider tiene esto que decir:

El uso de bloqueadores de anuncios aumentó un 30 % en 2016 (según PageFair)… Había 615 millones de dispositivos bloqueando anuncios en todo el mundo a fines de 2016, el 62 % (308 millones) de esos dispositivos móviles. El uso de bloqueadores de anuncios de escritorio creció un 17% año tras año a 236 millones.

El Dr. Johnny Ryan, Jefe de Ecosistema de PageFair concluyó:

En 2014, lidiamos con los primeros usuarios del bloqueo de anuncios. Estas personas realmente se preocupan y entienden los problemas reales de la privacidad y la fuga de datos en la tecnología publicitaria. Creo que lo que sucedió es que la falta de enfoque o interés de la industria en la privacidad permitió que el genio del bloqueo publicitario saliera de la botella.

Más recientemente, publiqué un artículo en Facebook sobre los peligros de Google Home en respuesta a este artículo: Google Home Mini grabó en secreto las conversaciones de las personas y generó un gran temor sobre los parlantes inteligentes.

Quedó claro a partir de este chat que, si bien las personas estaban educadas sobre la información que estaban dando a Facebook, no estaban del todo conscientes de la medida en que la estaban compartiendo.

El punto que estaba haciendo era una cuestión de ELECCIÓN.

NO es que “no podamos decir nada interesante”.

NO es que las personas deban ser paranoicas con las cosas que comparten en público.

Mi punto era que “lo que compartimos” puede no ser necesariamente nuestra eleccion.

Esa elección está determinada por las plataformas. Los datos que recopilan, públicos o privados, en sí mismos proporcionan suficiente forraje para crear gráficos sociales más definidos de todos y cada uno.

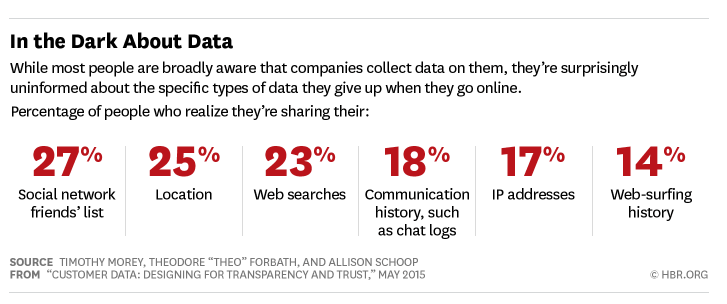

Recientemente, HBR publicó este artículo: Datos del cliente: diseño para la transparencia y la confianza

Publicaron estas estadísticas sobre la conciencia del consumidor sobre qué datos se comparten. La pregunta es ¿cuán consciente es el consumidor medio de lo que se recopila? En segundo lugar, si lo supieran, ¿estarían preocupados?

En estos días, sin embargo, existe esta idea de intercambio justo entre el usuario y las empresas que recopilan o analizan datos. Los consumidores esperan un servicio mucho mejor y comunicaciones más relevantes por parte de la empresa a cambio de la información que comparten.

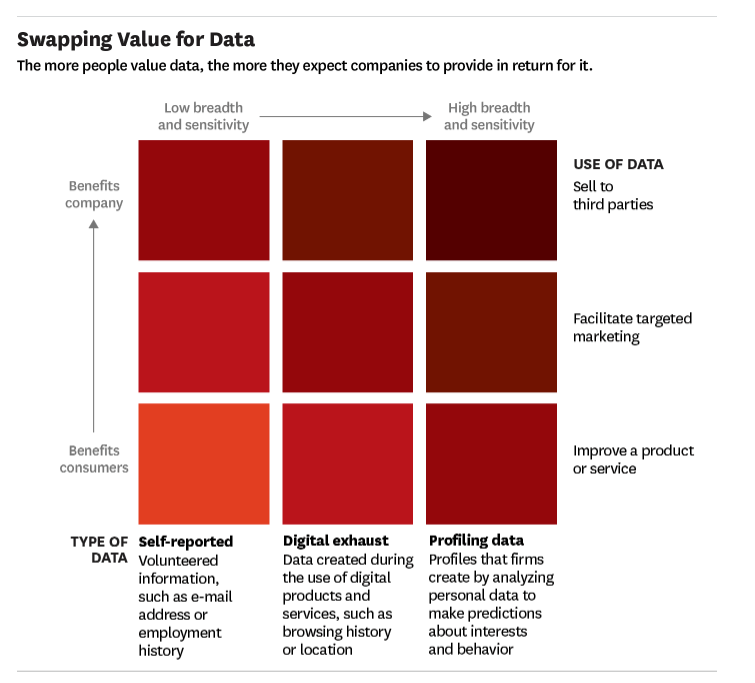

El gráfico del artículo de HBR muestra esta noción de intercambio justo. Cuantos más datos recopila una empresa, aumentan los niveles de expectativa del consumidor. Para empresas como Facebook, cuyo negocio principal incluye publicidad altamente dirigida a partir de su recopilación de datos de usuarios, el análisis requerido para perfilar y predecir las propensiones de los usuarios en última instancia generará más ingresos para la empresa.

Y a medida que crezca esta demanda, también aumentará el precio de una mayor contextualización a nivel individual. Cuanto más comprenda una empresa la motivación y la intención del usuario, más podrá desarrollar campañas más efectivas con una mayor predicción de la respuesta del consumidor.

AI: Donde el contexto lo es TODO

Trabajo en IA. Veo los datos. También veo lo que es posible. En Humans for AI, también hablo con científicos de datos que analizan grandes cantidades de información todos los días. Todos somos conscientes de las ventajas y desventajas de correlacionar esta información.

Durante mi conversación con uno de nuestros miembros fundadores, Neeraj Sabharwal, también ex arquitecto/ingeniero de Big Data en Horton Works, me transmitió la importancia de que cada consumidor sea responsable de lo que cada uno de nosotros comparte en sus dispositivos. Lo que divulgamos, pública o privadamente, y cómo compartimos esta información, puede usarse para extraer información en conjunto o a nivel individual. Neeraj señaló que los usuarios de Venmo comparten toda su actividad públicamente de forma predeterminada, a menos que elijan compartir la transferencia de dinero en privado o solo con amigos. Este artículo de Wired explica en detalle cómo te rastrea Google y cómo puedes evitar o reducir el rastreo.

La conciencia es la clave y una vez que conocemos el linaje de datos (qué, cómo,

dónde y quién accede a nuestros datos) entonces podemos ser más conscientes de nuestras decisiones.

Discutimos el trabajo que Elon Musk y Open AI estaban haciendo con IA y gobernanza. OpenAI se enfoca en “Descubrir y promulgar el camino hacia a salvo Inteligencia general artificial. Según Musk:

Creo que la IA es probablemente el elemento más importante a corto plazo que probablemente afectará a la humanidad. Entonces, es muy importante que tengamos el advenimiento de la IA en el buen sentido, que es algo que si pudieras mirar en una bola de cristal y ver el futuro, te gustaría ese resultado. Porque es algo que podría salir mal… Así que realmente necesitamos asegurarnos de que salga bien.

Considere que los datos son más que lo que compartimos en diferentes redes sociales, nuestro correo electrónico, nuestras transacciones, nuestros chats de atención al cliente. Se trata de la agregación de información de todas estas fuentes de datos dispares… y la correlación de información a través de IA que tiene la capacidad de encontrar patrones con una capacidad sin precedentes. Por primera vez en la historia, esta combinación de datos, poder de cómputo, mayor interconectividad y avances en el análisis de patrones están haciendo completamente posible la contextualización (y esto puede ser discutible en esta etapa incipiente) aumentando la exactitud y la precisión.

Lo que las regulaciones de privacidad de hoy pueden no considerar es el derecho del usuario a dar permiso para usar la información en una variedad de contextos que van más allá del servicio al cliente o las implicaciones de comunicación. Esto puede incluir:

1) A nivel personal: proporcionar recomendaciones y notificaciones de salud, o proporcionar recordatorios de tareas diarias

2) A nivel agregado: ayudar a la investigación médica a diagnosticar mejor las condiciones o prevenir posibles amenazas a la seguridad.

La información ahora evolucionará más allá de lo que compartimos en nuestras redes sociales ya las empresas. Estaremos instrumentando nuestros hogares, nuestro trabajo y nuestros cuerpos con sensores y dispositivos AR. Nuestra búsqueda de una mayor comodidad a través de la automatización puede generar resultados involuntarios en el proceso: el riesgo de sesgo, intencional o no.

El reciente anuncio de Facebook de cambiar el algoritmo Newsfeed para priorizar el contenido de amigos y familiares sobre las promociones de marca muestra todos los indicios de que Facebook se toma en serio alejarse de su negocio principal de medios y convertirse en un jugador de datos importante en esta próxima etapa de IA. Con la gran cantidad de información del usuario que captura, este movimiento solidifica la intención de Facebook de alentar un mayor comportamiento del usuario a raíz del “colapso del contenido”…

… eso es ver a las personas compartir información menos íntima y, en cambio, moverse a sitios más nuevos y más pequeños como Snapchat o Instagram para hacerlo.

Contextualización en juego: calificación crediticia social de China

He estado siguiendo los créditos de sésamo de China durante algún tiempo. Recientemente se anunció que China planea lanzar su sistema de crédito social en 2020. El artículo titulado, “Los grandes datos se encuentran con el Gran Hermano a medida que China avanza para calificar a sus ciudadanos” está poniendo en marcha una plataforma que investiga el comportamiento social de sus 1.300 millones de ciudadanos en un intento de juzgar su “confiabilidad”. El sistema de puntuación es un valor dinámico que sube y baja según el comportamiento individual. La confiabilidad está definida por el gobierno chino y es un sistema, peor que la prisión, que mantiene a los ciudadanos en cumplimiento. Esta forma de gamificación da vida al condicionamiento operante de BF Skinner a través de la IA, un sistema de castigo y recompensa donde los datos de las personas ahora se usan en su contra.

La incipiente AI es una oportunidad para tomar epronto control de lo que nosotros DESEAR permanecer en privado

La civilización occidental y nuestros ciudadanos, sin duda, no son inmunes a la recopilación, agregación y análisis masivos de datos a un nivel mucho más granular. Pero tenemos opciones y la libertad nos otorga ciertos derechos.

La Dra. Ann Covoukian, ex Comisionada de Privacidad de Ontario y ahora Directora Ejecutiva del Instituto de Privacidad y Big Data y principal defensora mundial de la privacidad individual, ha comunicado de manera efectiva la creencia de que “la privacidad y la libertad están indisolublemente unidas”. Ann descarta el “suma cero” mentalidad de que las personas deben elegir entre privacidad o seguridad, pero no pueden tener ambas.

Ella cree que no tenemos que renunciar a la privacidad individual para mantener segura a nuestra sociedad. Si tenemos que pasar a una aquiescencia común de vigilancia masiva, renunciamos a nuestras libertades individuales. Con la llegada de los grandes datos, esto no no tiene que ser el caso.

Y esta convicción está ampliamente extendida en Canadá, y ahora, con la implementación del Reglamento General Europeo de Protección de Datos (GDPR) que entró en vigor en mayo de 2018, se está promulgando un sistema más generalizado y armonizado de privacidad de datos. Ahora se requerirán sistemas y políticas para hacer cumplir esto de manera proactiva. Lea aquí cómo los usuarios obtendrán mucho más control sobre sus datos sociales.

Independientemente, todos tenemos la responsabilidad de, como aludió Neeraj, ser responsables de lo que compartimos y cómo lo compartimos. A medida que nuestros hijos crezcan en este mundo de creciente transparencia, deberán comprender las limitaciones de este nuevo mundo y, en última instancia, tener control sobre su información personal.

Esta publicación apareció originalmente en Humans for AI y es el tema de discusión para el evento en Toronto el 23 de enero.